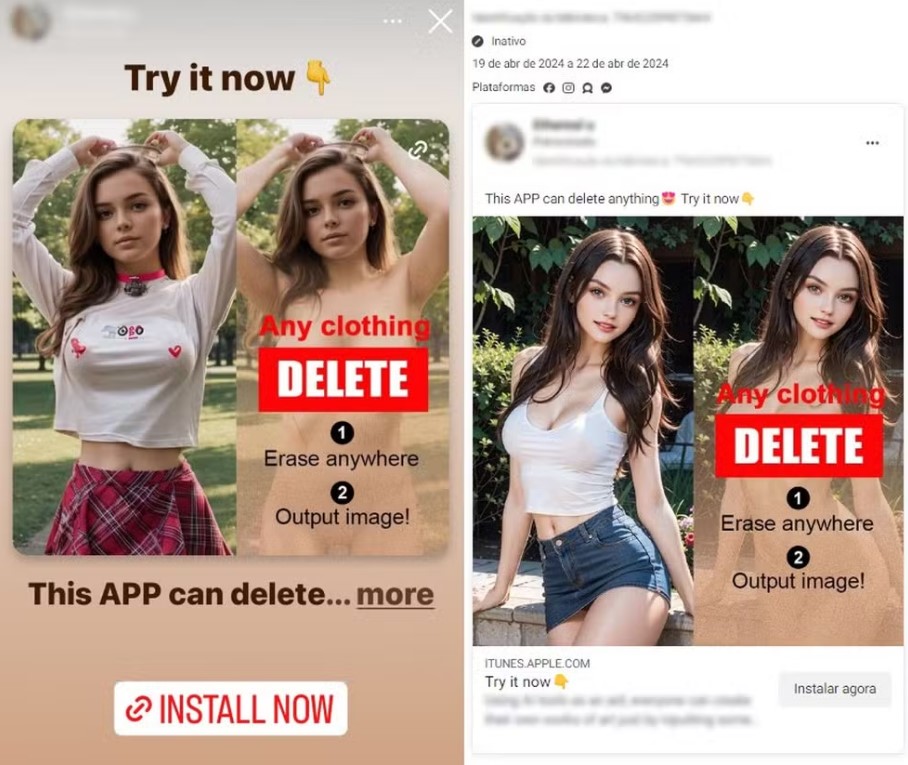

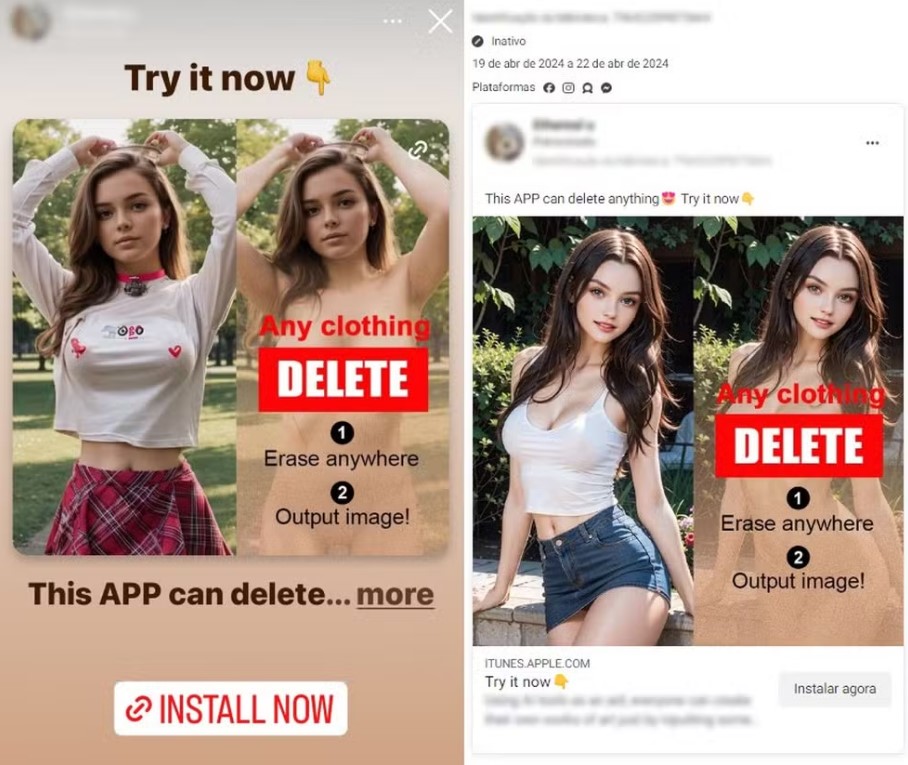

As redes sociais Instagram e Facebook divulgaram recentemente milhares de anúncios pagos relacionados a aplicativos que removem roupas de mulheres via IA. Mesmo com o Meta proibir nudez em sua plataforma, os responsáveis pelas ferramentas de manipulação de imagem não tiveram problemas em veicular seu material nas plataformas.

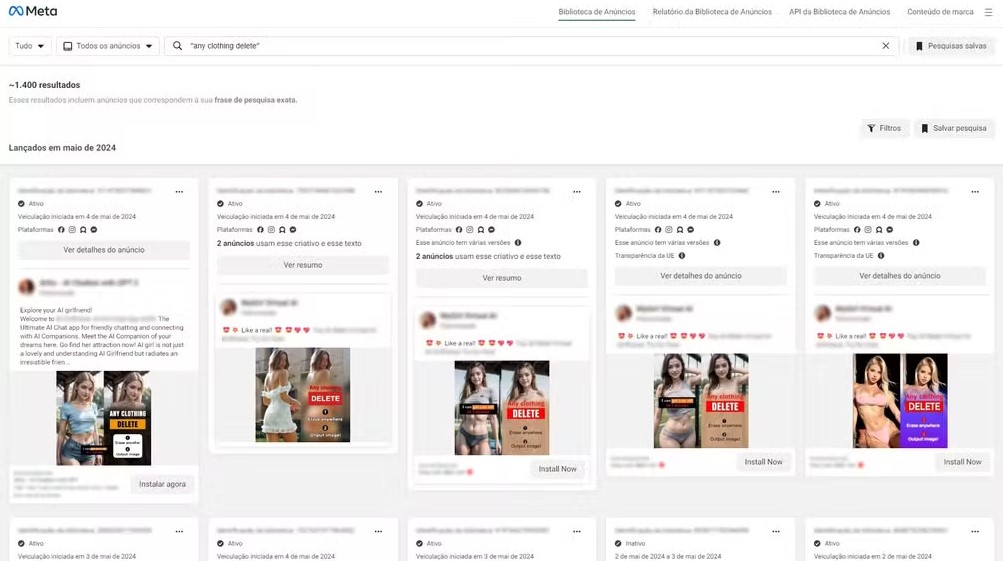

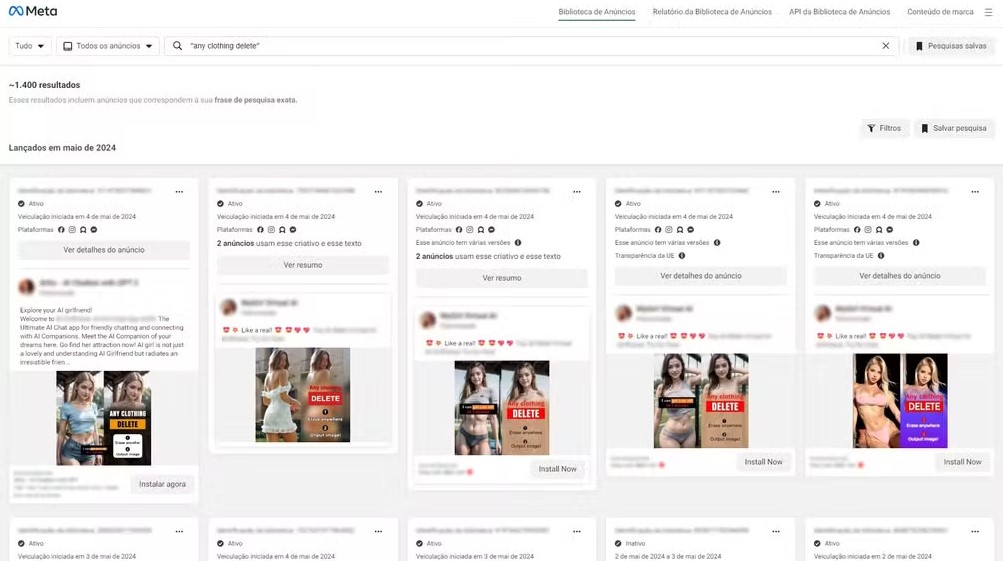

De dezembro de 2023 a abril de 2024, foram 1.400 propagandas veiculadas em ambas as redes sociais. Destas, 150 puderam ser encontradas no Brasil. Deste total, apenas 15% foram removidas pela Meta. As demais, que prometem a criação de “nudes” sem o consentimento das pessoas, continuam online.

Veja mais:

É importante mencionar que o Meta não divulga informações públicas sobre quanto tempo os anúncios permaneceram no Instagram e Facebook antes de serem removidos destas plataformas, assim como o valor pago pelos seus responsáveis.

Ao G1, o Meta afirmou que utiliza a inteligência artificial e profissionais humanos na fiscalização do conteúdo e remoção daqueles que violem suas normas – no entanto, apesar de remover aqueles que foram denunciados pela reportagem do grupo Globo, vários outros foram criados posteriormente.

Segundo o 404 Media, anúncios deste gênero seguem um padrão de palavras-chave como “any clothing delete”, “undress” e “nudify” dentro do Instagram e Facebook. Apesar das promessas, na verdade muitos deles são apps de simulação de namoro com uma inteligência artificial – não entregando o conteúdo que muitos buscaram.

Em resposta ao G1, um representante do Meta falou as ações que estiveram realizando no Instagram e Facebook para impedirem um aumento de anúncios do gênero.

Removemos os anúncios apontados pela reportagem por violar nossas políticas. Revisamos conteúdo por meio da combinação de tecnologia de Inteligência Artificial e equipes humanas, que nos ajudam a detectar, analisar e remover conteúdos que violem os Padrões da Comunidade do Facebook, as Diretrizes da Comunidade do Instagram e os nossos Padrões de Publicidade. Estamos sempre aprimorando nossos esforços para manter nossas plataformas seguras e também incentivamos as pessoas a denunciarem conteúdos e contas que acreditem violar nossas políticas através das ferramentas disponíveis dentro dos próprios aplicativos

Com uso de ferramentas de inteligência artificial, muitos estão usando aplicativos do gênero para cometer crimes contra o próximo. Em 2023, por exemplo, mais de 20 alunas de escolas do Rio de Janeiro foram vítimas de montagens de fotos nuas e os suspeitos são outros alunos – realizando as alterações e compartilhando o conteúdo com amigos.

Casos similares estão sendo vistos desde então, como o que ocorreu em março de 2024 em um colégio no Rio Grande do Sul. Além do fato de serem menores de idade, o conteúdo também fere leis sobre direitos de imagem das vítimas e podem levar os responsáveis e quem mantém estas fotos para a cadeia – como previsto na Lei 13.718/2018.

Fonte: G1