O Instagram está se preparando para lançar um novo recurso de segurança que desfoca imagens de nudez em mensagens, como parte dos esforços para proteger menores na plataforma contra abusos e golpes sexualmente exploratórios.

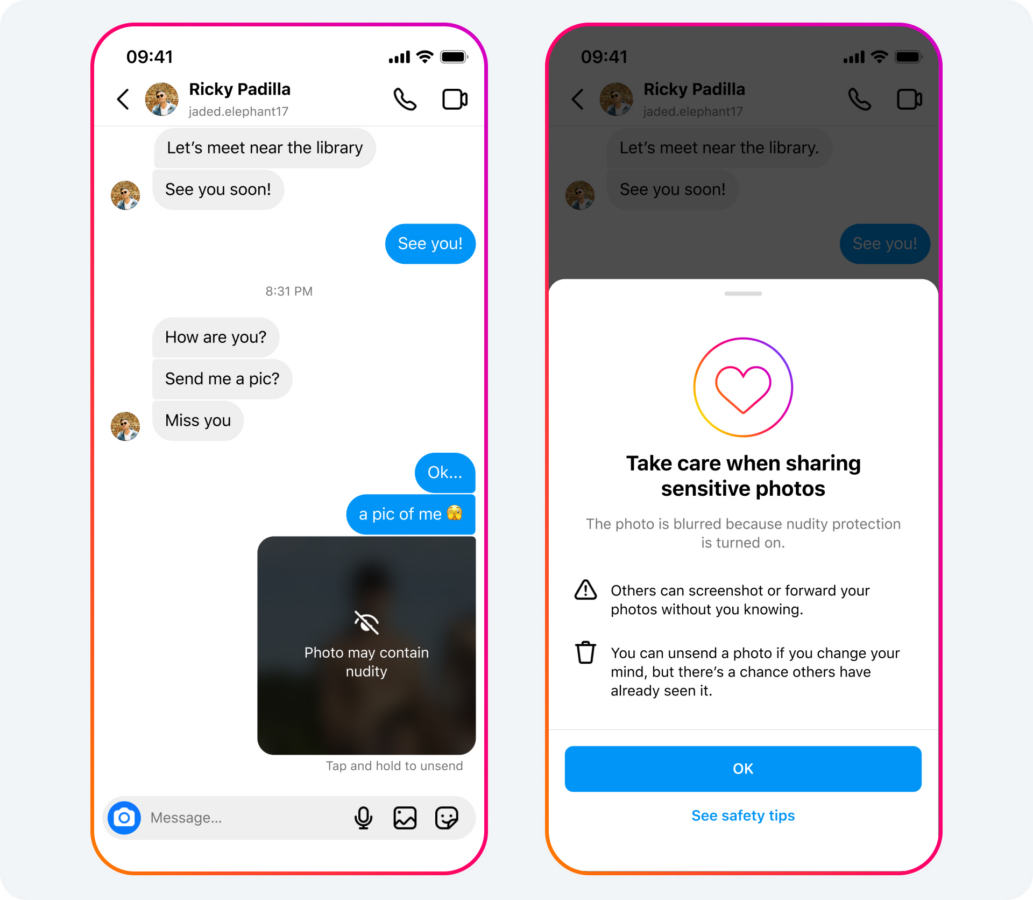

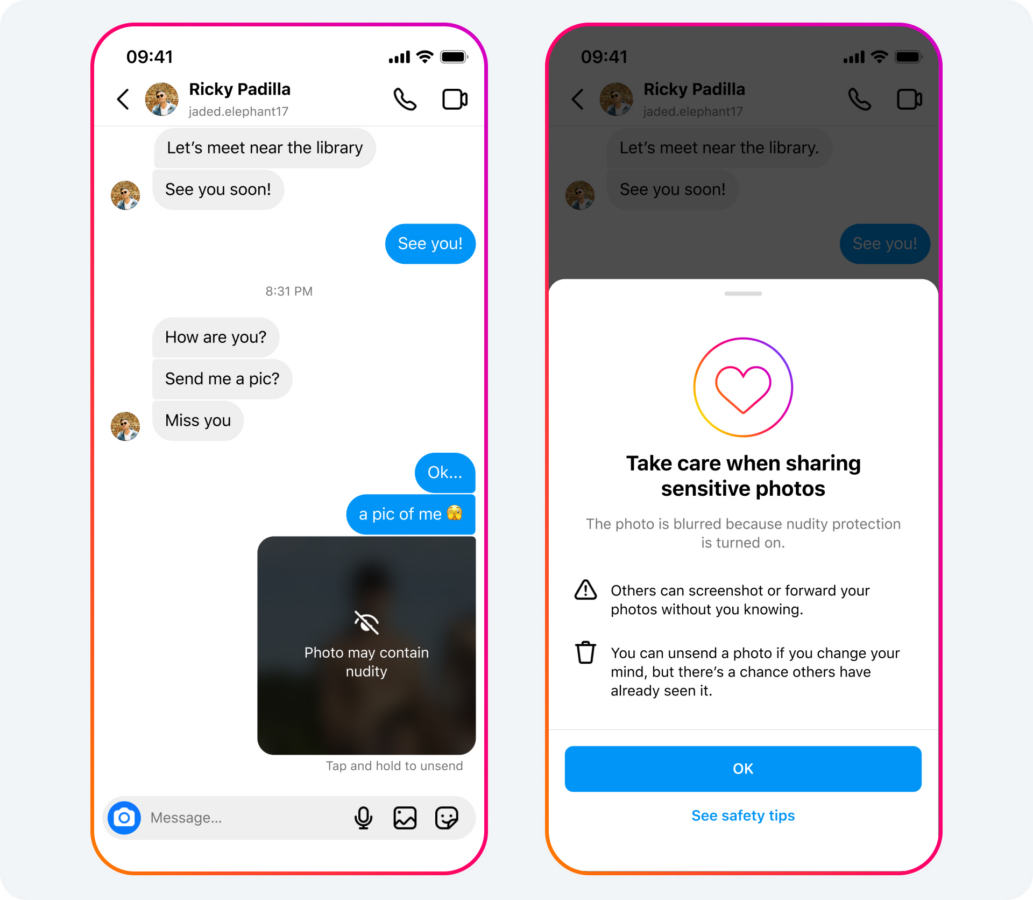

Anunciado pela Meta na quinta-feira (11), o novo recurso — que desfoca imagens detectadas como contendo nudez e desencoraja os usuários de enviá-las — será ativado por padrão para os usuários adolescentes do Instagram, identificados pela data de nascimento em suas contas. Uma notificação também incentivará os usuários adultos a ativá-lo.

Esses esforços seguem críticas de longa data de que plataformas como Facebook e Instagram causaram danos aos seus usuários mais jovens, desde prejudicar a saúde mental e a imagem corporal das crianças até conscientemente dar visibilidade a pais abusivos e criar um “mercado para predadores em busca de crianças”.

Como encontrar o jogo secreto na DM do Instagram

O novo recurso será testado nas próximas semanas, de acordo com o Wall Street Journal, com uma implementação global esperada nos próximos meses. A Meta afirma que o recurso utiliza aprendizado de máquina no dispositivo para analisar se uma imagem enviada por meio do serviço de mensagens diretas do Instagram contém nudez, e que a empresa não terá acesso a essas imagens a menos que tenham sido denunciadas.

Quando a proteção estiver ativada, os usuários do Instagram que receberem fotografias nuas receberão uma mensagem dizendo-lhes para não se sentirem pressionados a responder, juntamente com opções para bloquear e denunciar o remetente.

“Este recurso é projetado não apenas para proteger as pessoas de ver nudez indesejada em suas DMs, mas também para protegê-las de golpistas que podem enviar imagens nuas para enganar as pessoas a enviarem suas próprias imagens em troca“, afirmou a Meta em seu anúncio.

Os usuários que tentarem enviar uma mensagem direta com nudez também verão uma mensagem de aviso sobre os perigos de compartilhar fotos sensíveis, enquanto outra mensagem de aviso desencorajará os usuários que tentarem encaminhar uma imagem de nudez que tenham recebido.

Este é o mais recente das tentativas da Meta de reforçar as proteções para crianças em suas plataformas, tendo apoiado uma ferramenta para remover imagens sexualmente explícitas de menores offline em fevereiro de 2023 e restringido o acesso a tópicos prejudiciais como suicídio, automutilação e distúrbios alimentares ainda este ano.

Fonte: Meta