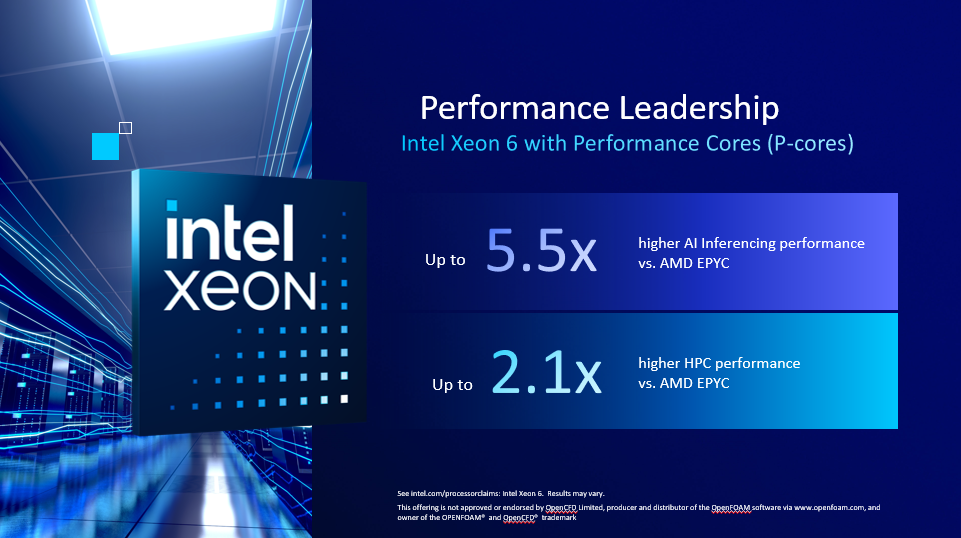

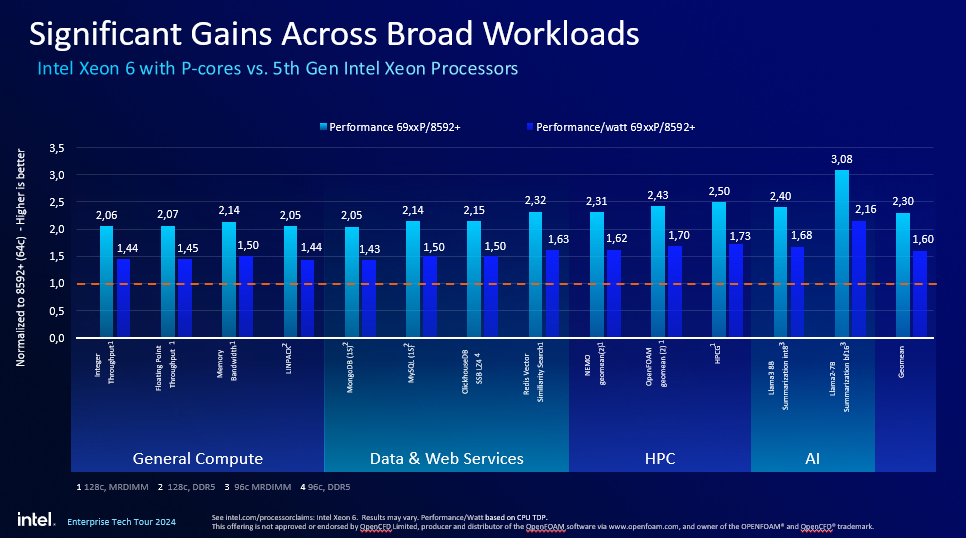

A Intel apresentou nesta terça-feira (24) os novos Xeon 6 com núcleos de desempenho (P-cores) e aceleradores de IA Gaudi 3. A promessa é de dobrar o desempenho para cargas de trabalho IA e HPC, oferecendo até 20% mais rendimento e uma relação 2x/desempenho em comparação com a solução concorrente.

“A demanda por IA está levando a uma transformação massiva no data center, e a indústria está pedindo escolha em hardware, software e ferramentas de desenvolvedor”, destacou Justin Hotard, vice-presidente executivo da Intel e gerente geral do Data Center and Artificial Intelligence Group.

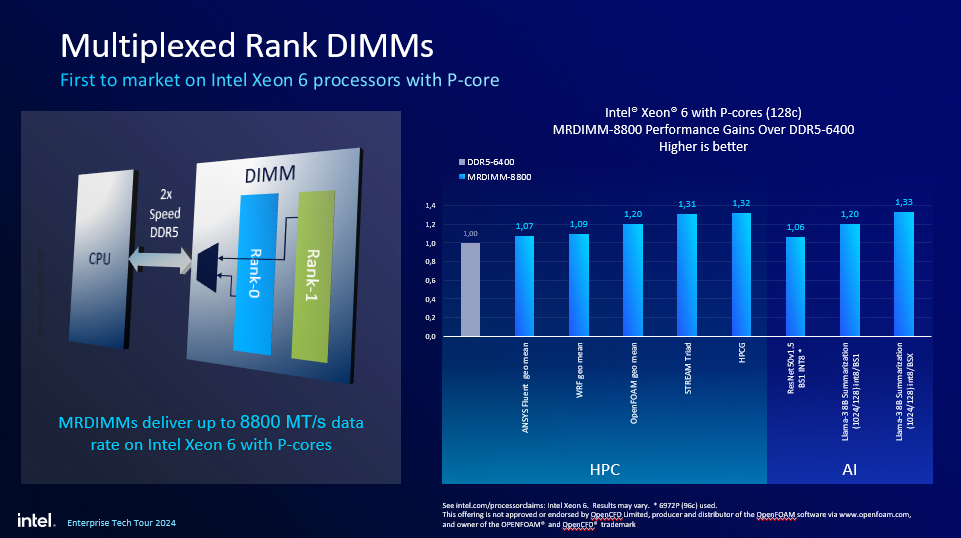

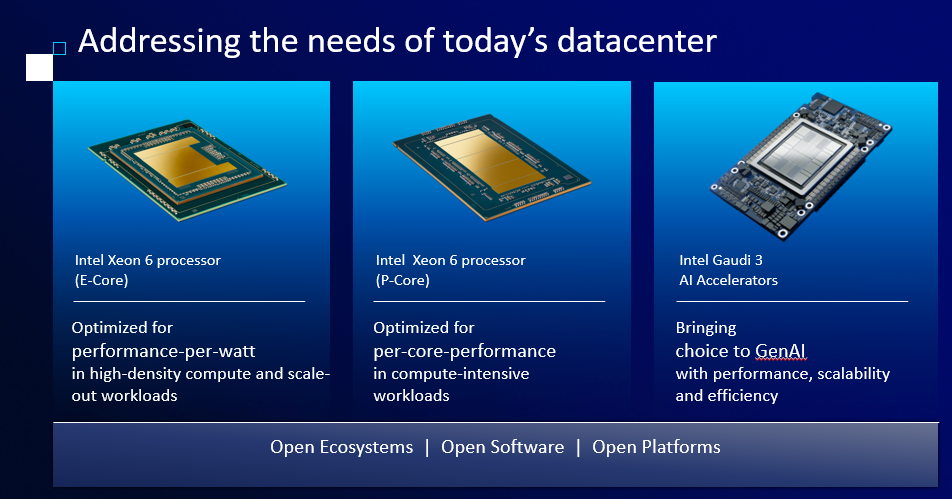

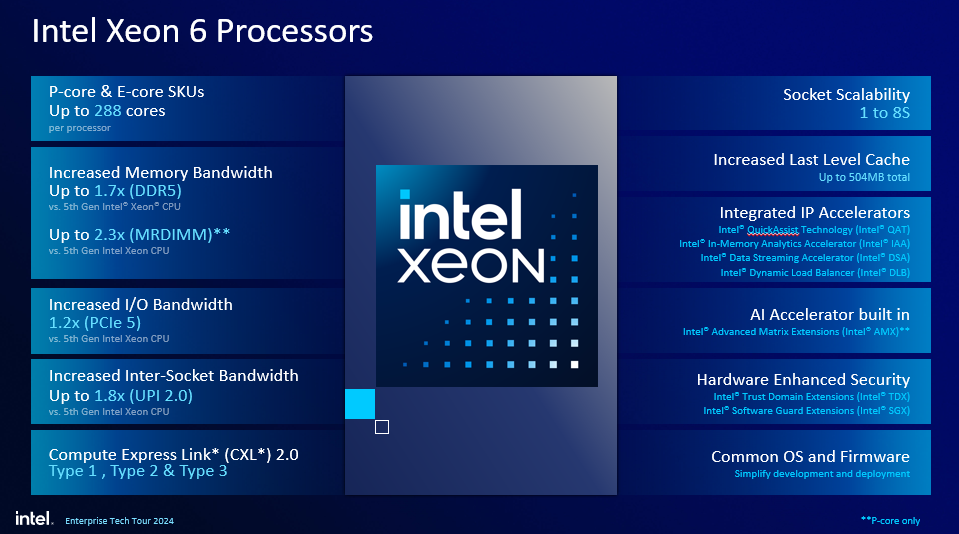

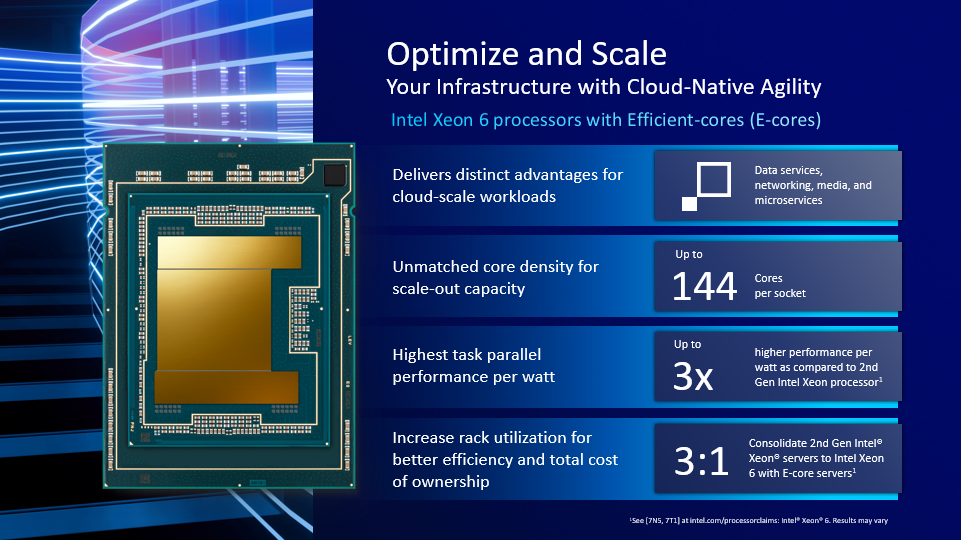

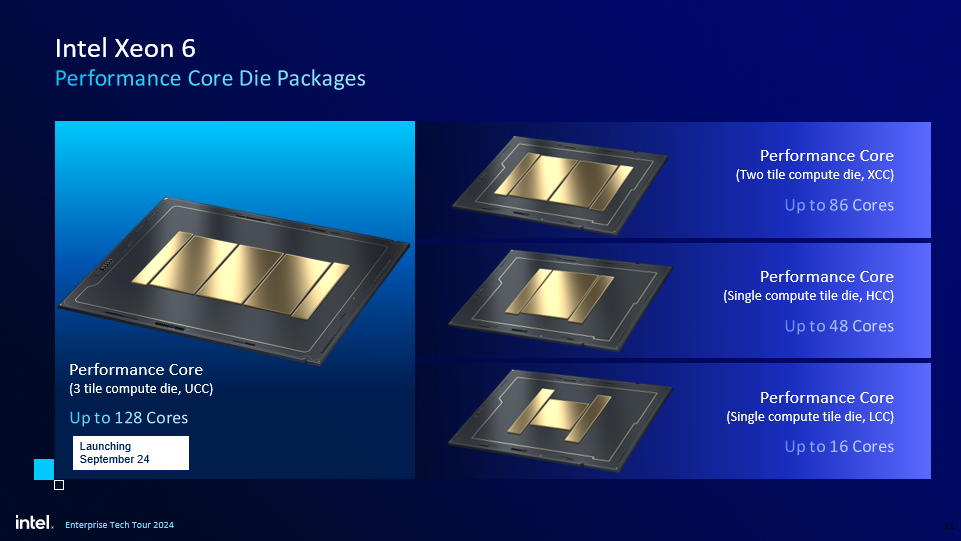

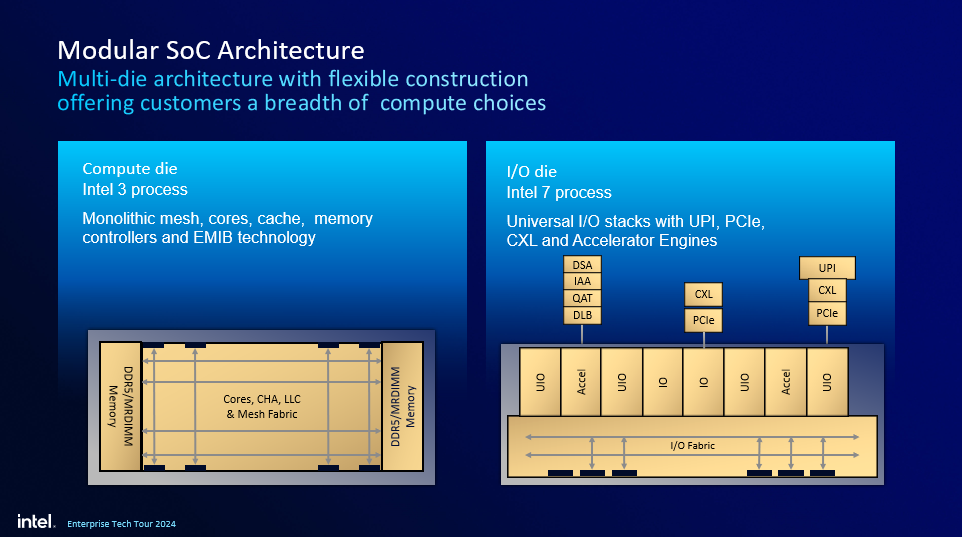

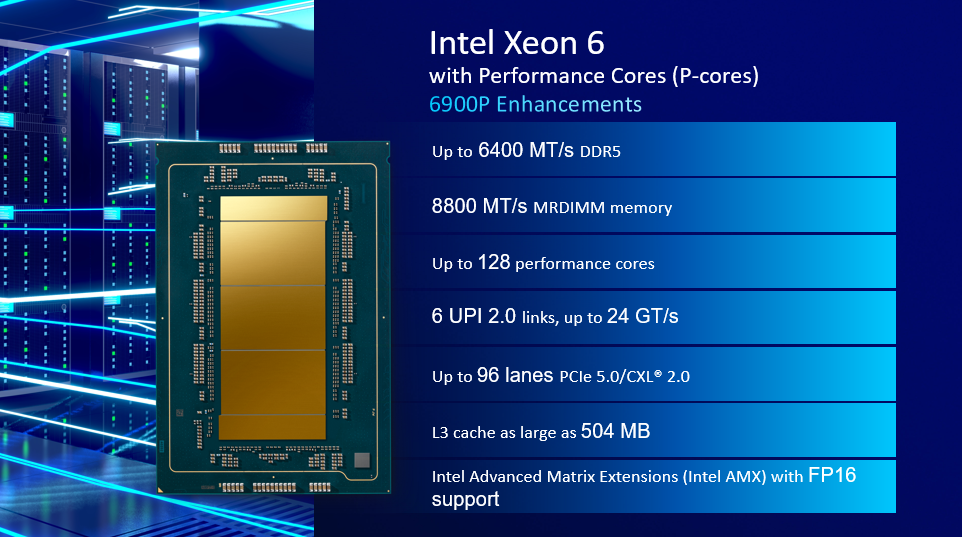

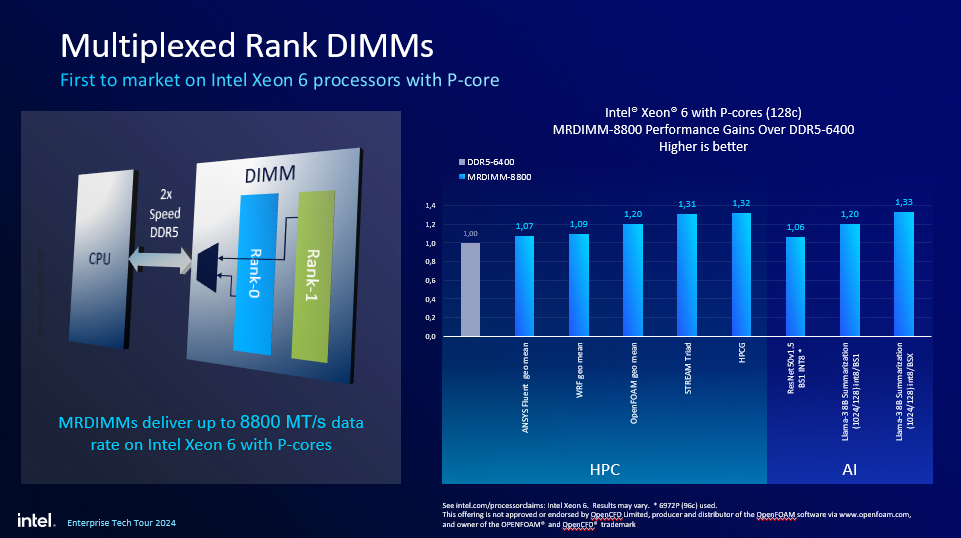

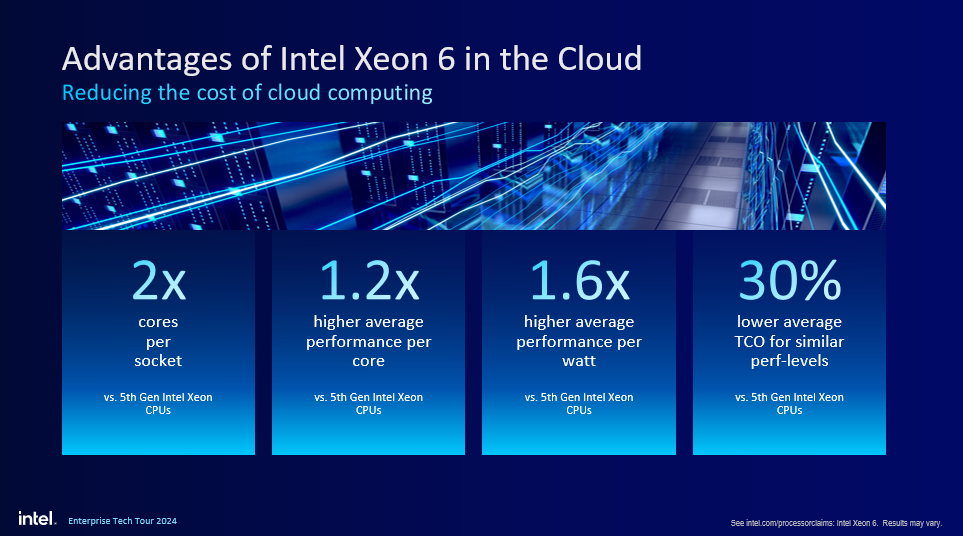

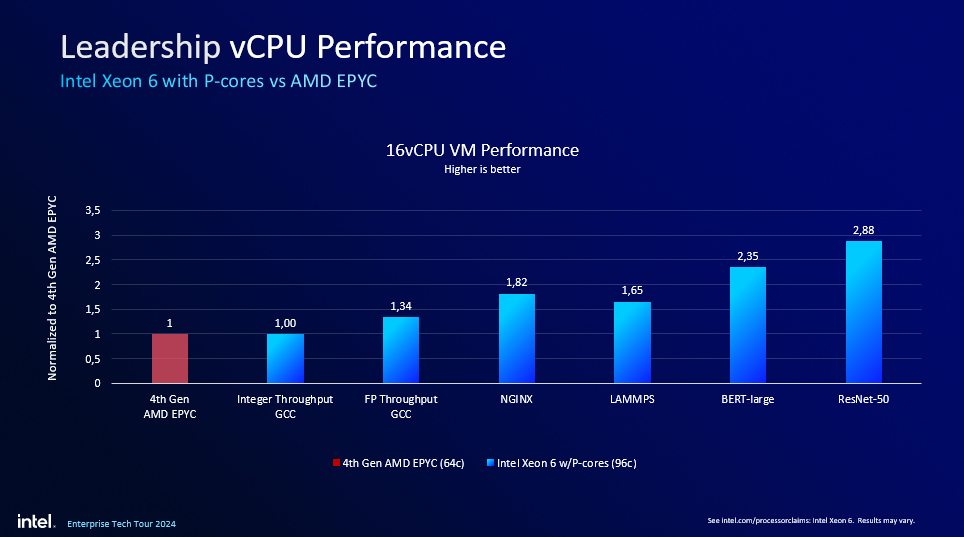

Segundo a Intel, o Xeon 6 oferece o dobro de desempenho se comparado com o sue antecessor. Agora com núcleos P-Core, ele foi projetado para lidar com cargas de trabalho intensivas em computação.

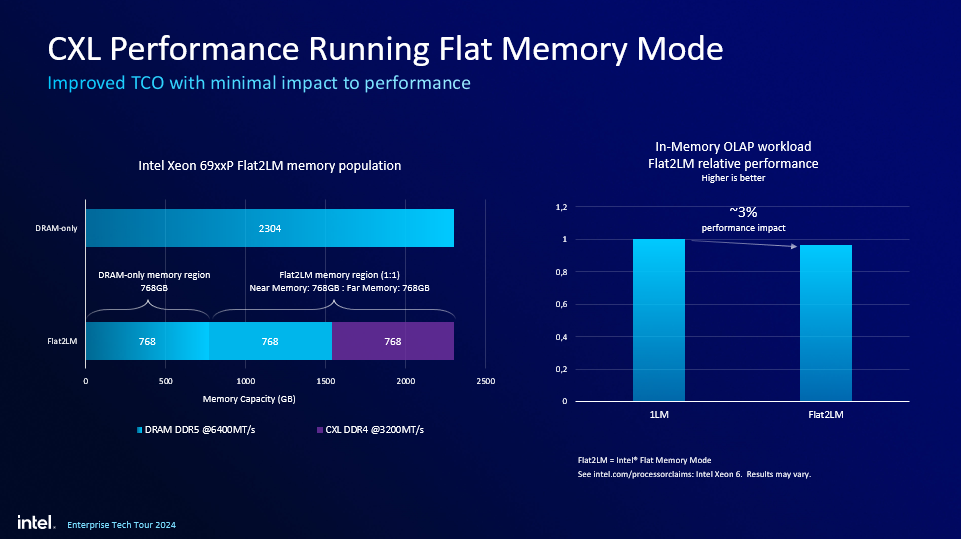

Na prática, ele oferece maior contagem de núcleos, o dobro da largura de banda de memória e recursos de aceleração de IA incorporados em cada núcleo. O foco aqui é atender diretamente às demandas por desempenho em IA, da borda ao data center e em ambientes de nuvem.

Outra novidade é o acelerador de IA Intel Gaudi 3, especificamente otimizado para IA generativa em larga escala. Ele conta com 64 núcleos de processador Tensor (TPCs) e oito mecanismos de multiplicação de matrizes (MMEs). As especificações incluem ainda:

- 128 GB de memória HBMe2, para treinamento e inferência;

- 24 portas Ethernet de 200 Gb para rede escalável.

Além disso, há compatibilidade com estrutura PyTorch e modelos avançados de transformador e difusor Hugging Face. Vale lembrar que recentemente a Intel anunciou uma colaboração com a IBM para implementar aceleradores Gaudi 3 como um serviço na IBM Cloud.

Em comparação direta com o principal concorrente, o NVIDIA H100, a Intel acredita que oferece algumas vantagens. A primeira delas é a disponibilidade: os prazos de entrega do H100 giram em torno de 54 semanas, enquanto a Intel consegue atender as empresas em um prazo muito mais reduzido.

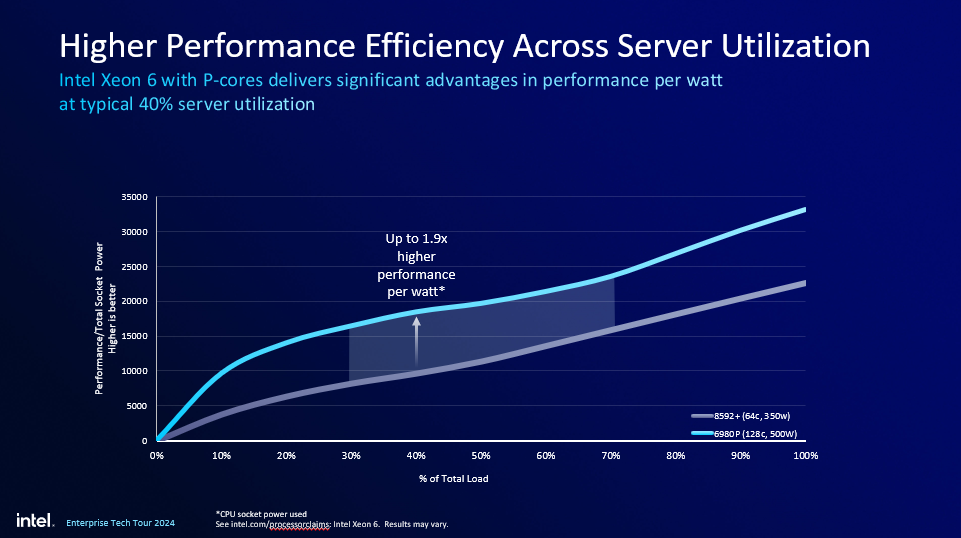

Além disso, são destaques a maior eficiência energética, o menor custo de implementação e um melhor custo total de propriedade (TCO). A empresa destaca ainda o fato de usar um software open source contra uma opção proprietária disponibilizada pela NVIDIA.

A implantação de IA em escala envolve considerações como opções de implantação flexíveis, relações preço-desempenho competitivas e tecnologias de IA acessíveis.

Nesse cenário, a infraestrutura x86 robusta da Intel e o amplo ecossistema aberto a posicionam para dar suporte a empresas na construção de sistemas de IA de alto valor com um TCO e desempenho por watt ideais. Como referência, 73% dos servidores acelerados por GPU usam Intel Xeon como sua CPU de base.

Leia também: Intel aposta na criação de chip com 1 trilhão de transistores até 2030

A Intel fez parcerias com OEMs líderes, incluindo Dell Technologies, Hewlett Packard Enterprise e Supermicro, para desenvolver sistemas coprojetados sob medida para necessidades específicas do cliente para implantações de IA eficazes.

A Dell Technologies está atualmente coprojetando soluções baseadas em RAG, aproveitando o Gaudi 3 e o Xeon 6. Essas soluções, construídas na plataforma Open Platform Enterprise AI (OPEA), integram microsserviços baseados em OPEA em um sistema RAG escalável, otimizado para sistemas Xeon e IA Gaudi, projetados para permitir que os clientes integrem facilmente aplicativos do Kubernetes e do Red Hat OpenShift.